La intel·ligència artificial (IA) ha irromput en allò que anomenem la societat de la informació i el coneixement. Nombroses indústries han estat realitzant anàlisis urgents sobre l'impacte de la IA: des de les finances o les indústries creatives, fins a les administracions públiques o l'educació. Però com pot posicionar-se el sector de la comunicació i, més específicament, el periodisme, davant aquesta realitat?

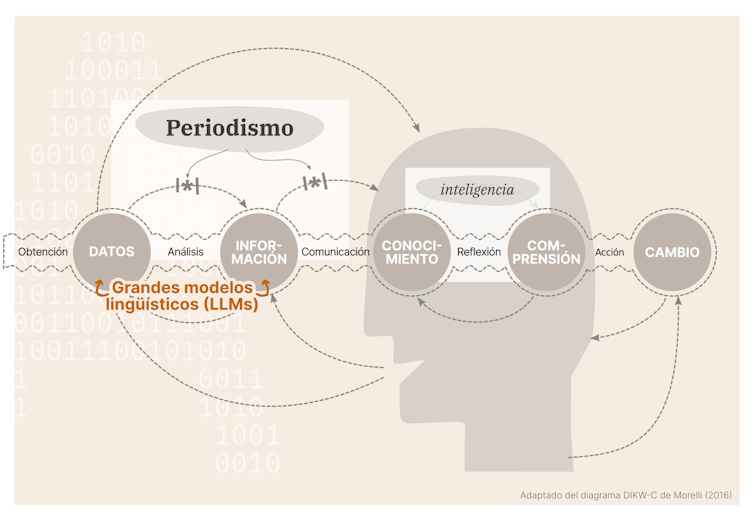

Resulta útil recuperar en aquest context un model sobre com construïm el coneixement que rep diferents noms: la piràmide o la jerarquia del coneixement, o també el continuum de la comprensió. Explica que l'organització i presentació de les dades és el que permet transformar-les en informació útil i significativa, que pot contribuir a generar coneixement o fins i tot comprensió o saviesa. El procés pot continuar fins a la generació de canvi a través de l'acció o la presa de decisions.

És rellevant recalcar que totes les fases o elements d'aquest procés mantenen relació amb les anteriors i, en última instància, amb la realitat d'arrencada. El procés es fonamenta en la realitat i adquireix continuïtat i sentit en contrast amb ella.

Com utilitza la IA el llenguatge

En aquest model de generació de coneixement, més enllà de les dades o la informació, el procés és un fenomen humà. A diferència de les fases anteriors, que poden externalitzar-se, transportar-se i manipular-se en altres suports físics com el paper o un disc dur, no és possible que la reflexió o el pensament, ni per tant el coneixement, la comprensió o la intel·ligència, ocorrin fora de la ment humana.

En totes aquestes transformacions, el llenguatge juga un paper essencial. L'anàlisi o l'organització de les dades estan marcats per la sintaxi de la llengua, i aquesta, per tant, condiciona en certa mesura les possibilitats disponibles per a aquesta estructuració. La llengua és també el vehicle principal de comunicació. Gran part del procés de reflexió s'articula també a través del llenguatge.

Les eines com ChatGPT es coneixen també a través del terme més específic i adequat "model lingüístic" (LLM, o large language model en anglès). Aquest tipus de robots basats en xats fan una creació lingüística probabilística i solament aparent. Proponen quines paraules són les més probables després de qualsevol altra paraula donada, basant-se en grans bases de dades, però no realitzen cap contrast amb la realitat.

El llenguatge, en tant que abstracció i interpretació de la realitat, solament funciona si tenim uns referents comuns i compartits sobre la relació entre significant i significat, entre la paraula i el referent. En absència d'aquest mínim consens, el diàleg o la discussió es converteix en un "diàleg de besucs".

Els models lingüístics, malgrat el seu nom, no manipulen significats ni, després d'haver generat comprensió i coneixement, comuniquen relats al voltant d'aquestes idees, com fem en els processos de comunicació humana. Actuen amb mera forma, només amb referents, només amb significants. Són capaços de generar llenguatge d'aparença humana, però totalment mancat de significat que els humans maneguem en fer generacions de llenguatge semblants.

No té les característiques de la intel·ligència humana

I, no obstant això, quan usem termes com "intel·ligència" per referir-nos a models lingüístics com ChatGPT, atorguem certa visió antropomòrfica a un algoritme, i li assignem, potser inconscientment, algunes característiques de la intel·ligència humana. Assumim que són capaços de comprendre, de manejar significats o, en termes més lingüístics, de referir-se a referents mitjançant el llenguatge que generen.

Altres molts termes que utilitzem (que s'han estès, que s'han difós) en aquest context presenten el mateix problema: es parla de "entrenament", o d'"aprenentatge", o de "al·lucinacions". Quan fem referència amb aquests termes al que fa ChatGPT, automàticament ens ve a la ment un entrenament humà, l'aprenentatge humà o les al·lucinacions humanes; i assignem a aquests instruments les característiques d'aquestes experiències humanes. No obstant això, aquesta representació és una il·lusió.

Una contribució més a la desinformació

Davant d'aquesta onada de models lingüístics cada vegada més sofisticats, continuen sent rellevants les professions relacionades amb la comunicació, com el periodisme? La contribució de la IA al panorama sembla ser, sobretot, en forma de fake news i desinformació, amb imatges generades per IA cada vegada més difícils de distingir de les reals.

El periodisme és un tipus de comunicació amb una funció social específica: "Proporcionar a la ciutadania la informació que necessita per ser lliure i governar-se a sí mateixa". Aquest propòsit requereix un compromís amb la veritat que podem entendre com una representació honesta de la realitat. D'altra banda, en gairebé tots els diccionaris la mentida o el que és fals es defineix mitjançant la negació de la veritat. En aquest sentit, la mentida reconeix certa legitimitat a la veritat, la necessita per a posicionar-se com la seva contrària.

En el context actual de postveritat, més que fake news o notícies de mentida, el que veiem essembala més a un complet desinterès per qualsevol relació del relat amb un referent real, més a prop de la xerrameca o el "trastorn informatiu".

Independentment de si el comunicat és veritat o mentida, en la postveritat el focus està en manipular creences i emocions amb la finalitat d'influir en l'opinió pública i en actituds socials. Vivim un moment de menyspreu per la importància de la veritat de la realitat.

En aquest context, que els models lingüístics o el que anomenem "intel·ligències artificials" no manegen cap referent real o contrast amb la realitat no resulta problemàtic. No és, per tant, que ChatGPT menti, o que invente, és que no té una noció del que és mentida (o el que és veritat). Però sí que les IA poden convertir-se en importants fonts de desinformació.

ChatGPT no substituirà al periodisme en la seva funció social perquè no ens ofereix interpretacions de la realitat que ens ajuden a prendre decisions. Però al mateix temps, les IA compliquen enormement que el periodisme pugui complir el seu propòsit, al reforçar un paradigma de menyspreu al valor de la veritat.

El periodisme ha de reafirmar-se

Quin és el paper del periodisme, llavors, respecte a l'avanç de la intel·ligència artificial? El primer, sens dubte, ha de ser reafirmar-se en la seva funció i resistir-se a la fascinació generada per la IA.

La imatge que ens hem construït de ChatGPT en particular i de les capacitats de la IA en general és, en gran part, la que s'esforcen en transmetre els seus creadors: ens ha atrapat l'admiració que ens han volgut provocar.

Aquesta fascinació desactiva l'olfacte periodístic i l'exigència de rendir comptes a les parts interessades. En lloc d'acceptar que l'amenaça de la IA és existencial i posa en perill el gènere humà en el seu conjunt, podriem centrar-nos en què les IA actuals són sistemes immadurs que en qualsevol altra indústria ni tan sols s'haurien autoritzat per a comercialitzar-se. Si, com planteja l'escriptor i bloguer Cory Doctorow, acceptem que "no es deuria confiar en ells per a pilotar drones o conduir cotxes (…) o determinar la teua solvència o la teua assegurabilitat, llavors totes aquestes empreses d'IA estarien en la fallida".

El periodisme té la capacitat i el deure d'entendre i explicar aquestes eines com el que són i observar les limitacions que presenten i els problemes i danys que estan causant ja (com els biaixos discriminatoris, l'impacte ambiental o l'explotació laboral).

És urgent que es plantegin les preguntes veritablement importants, aquelles per a les quals necessitem resposta, en lloc de deixar-se portar per la fascinació d'aquesta idea mística de la IA.

. Miren Berasategi Zeberio, Professora/investigadora en comunicació digital, Universitat de Deusto des de

Creative Commons Crònica CT

Cap comentari :